Graid recourt à des GPU pour accélérer le stockage flash

Exploitant la puissance de calcul des cartes GPU d'entrée de gamme pour station de travail, la start-up Graid Technology vient accélérer les ressources de stockage reposant sur des SSD NVMe grâce à son logiciel dédié.

Les vétérans se souviennent certainement de fournisseurs très spécialisés comme Matrox pour la gestion multiécran ou Adaptec pour la prise en charge des systèmes Raid avec des disques durs en mode SCSI ou IDE. Les technologies ont évolué et les capacités de stockage explosé, mais l'accélération et la reconstruction des ressources de stockage sont toujours un élément critique dans les entreprises. Si l'arrivée des SSD et de l'interface NVMe a décuplé les performances des SAN et autres NAS, la gestion des performances et, si besoin, la reconstruction des volumes Raid sont toujours au coeur des préoccupations de nombreux opérateurs et administrateurs.

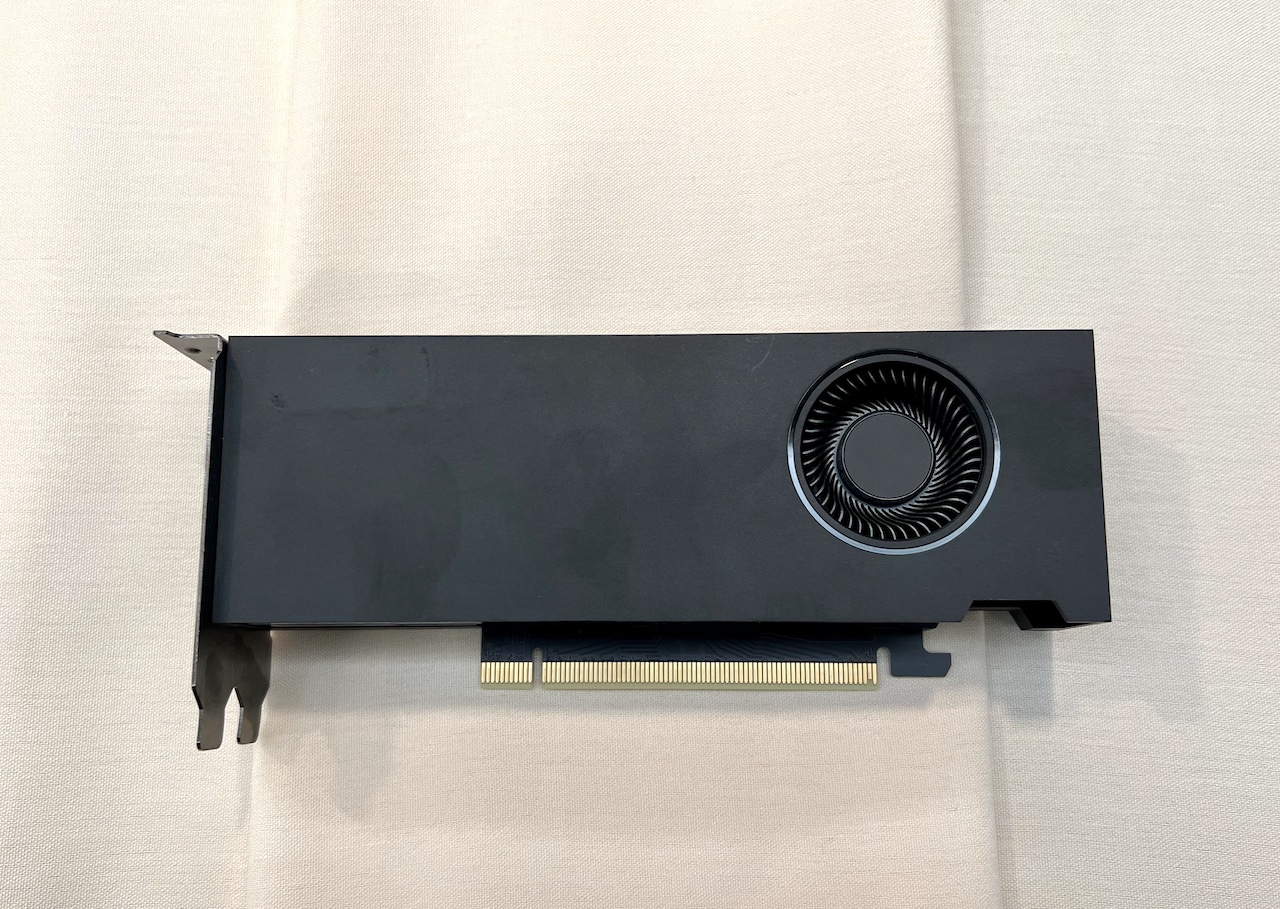

« Les entreprises dépensent beaucoup d'argent pour les SSD, bien plus qu'ils n'en dépenseraient sur le streaming médias en fin de compte, et elles n'arrivent pas à obtenir les performances vantées par les fournisseurs à cause du goulot d'étranglement », nous a expliqué Tom Paquette vice-président Ameriques et EMEA chez Graid Technology. Cofondée en 2020 par Leander Yu (CEO), cette start-upe posséde un pied à Taïwan (R&D) et l'autre dans la Silicon Valley à Santa Clara. « Avec une carte Raid traditionnelle - exploitant un ASIC - et supposons quatre SSD NVMe, tous évalués à 7 Go/s, le flux de données doit passer par la carte Raid et cette dernière devient un goulot d'étranglement (12 Go/s max). Il n'y a aucun moyen pour une carte Raid traditionnelle de prendre en charge la bande passante globale et la redistribuer ». Pour répondre à ce problème bien précis, Graid a développé une carte Raid (0 à 10) reposant sur des GPU Nvidia standard pour stations de travail travaillant avec les protocoles NVMe et NVMe over Fabric. «. Nous ne faisons absolument rien à cette carte, sauf mettre cette petite plaque de métal sur elle et brancher les ports IO à l'arrière. Nous prenons la puissance de ce GPU, et nous utilisons également la puce IA à l'intérieur du GPU. Et nous arrivons à traiter 19 millions d'IOPS sur notre carte PCI 4.0 avec des SSD NVMe, embarqués dans un serveur équipé d'une puce Xeon de troisième génération.

La carte A2000 de Nvidia est réutilisée par Graid pour travailler en mode Raid (0 à 10) avec des SSD NVMe. (Crédit S.L.)

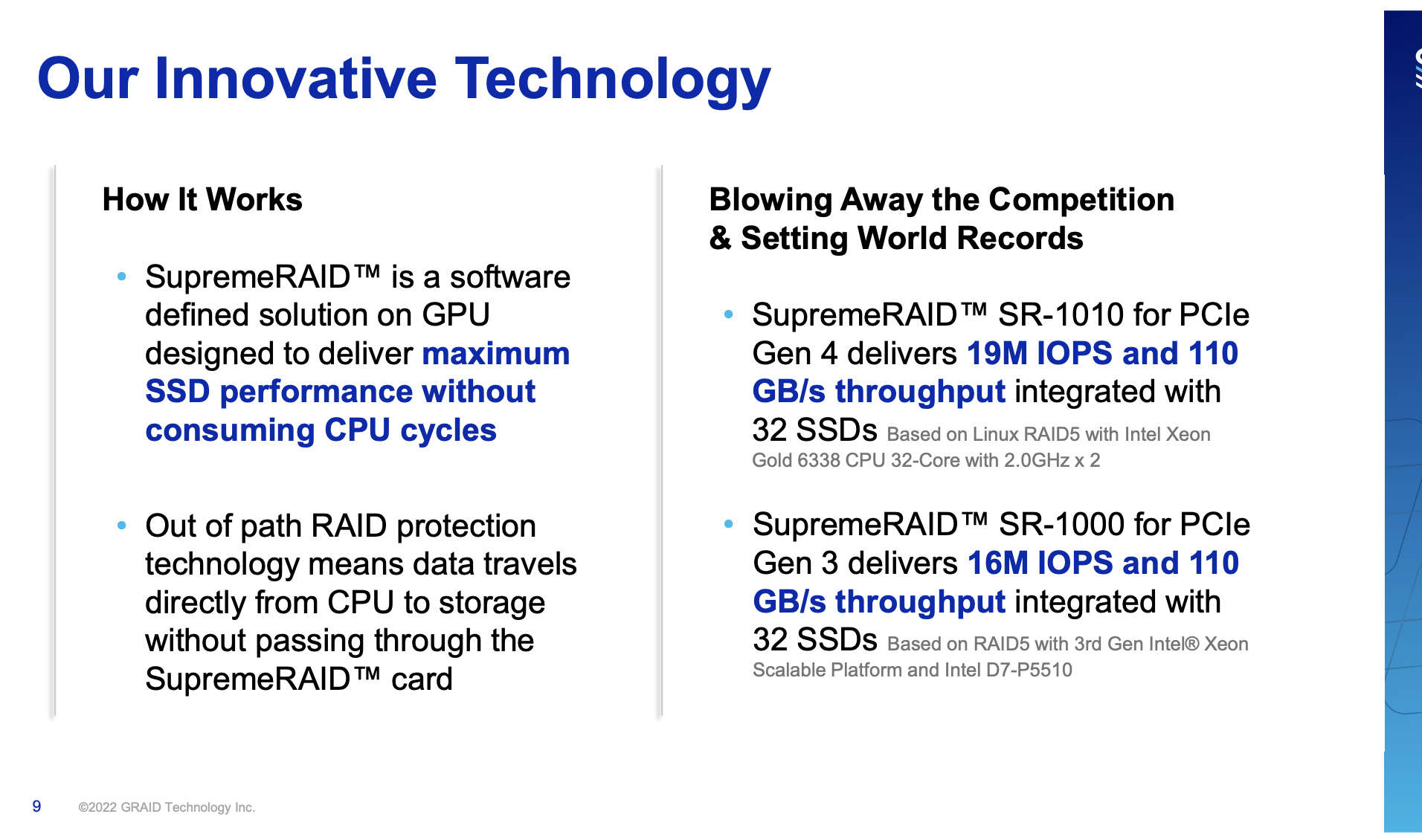

Broadcom et Intel comme concurrents

Jusqu'à 32 SSD NVMe sont supportés par les cartes de Graid, la SupremeRAID SR-1000 (sur base Nvidia T1000) sur l'interface PCI 3.0 (2 500$ HT) et la SR-1010 (sur base A2000) exploitant le PCI 4.0 (3 995$ HT). Un tarif qui comprend la carte GPU Nvidia et le logiciel développé par la start-up (licence perpétuelle). Une déclinaison PCI 5.0 est attendue en 2023 avec le support du protocole CXL et une ouverture vers les infrastructures composables. « Le logiciel Supreme est notre sauce secrète, qui s'installe sur un GPU et qui traite toutes les entrées-sorties sans intervention du CPU. Donc il ne consomme pas de cycles CPU. Nous l'appelons audit path. Et si vous y pensez spécifiquement dans la fonction de lecture, nous sommes un agent de circulation à l'intérieur du serveur et nous exploitons toute la puissance du GPU - qui est vraiment sous-utilisée (50% environ) en raison du nombre d'unités de calcul que ces cartes ont », a précisé Leander Yu.

Graid met en avant des résultats flatteurs, qu'il sera nécessaire de vérifier avec des tests indépendants. (Crédit S.L.)

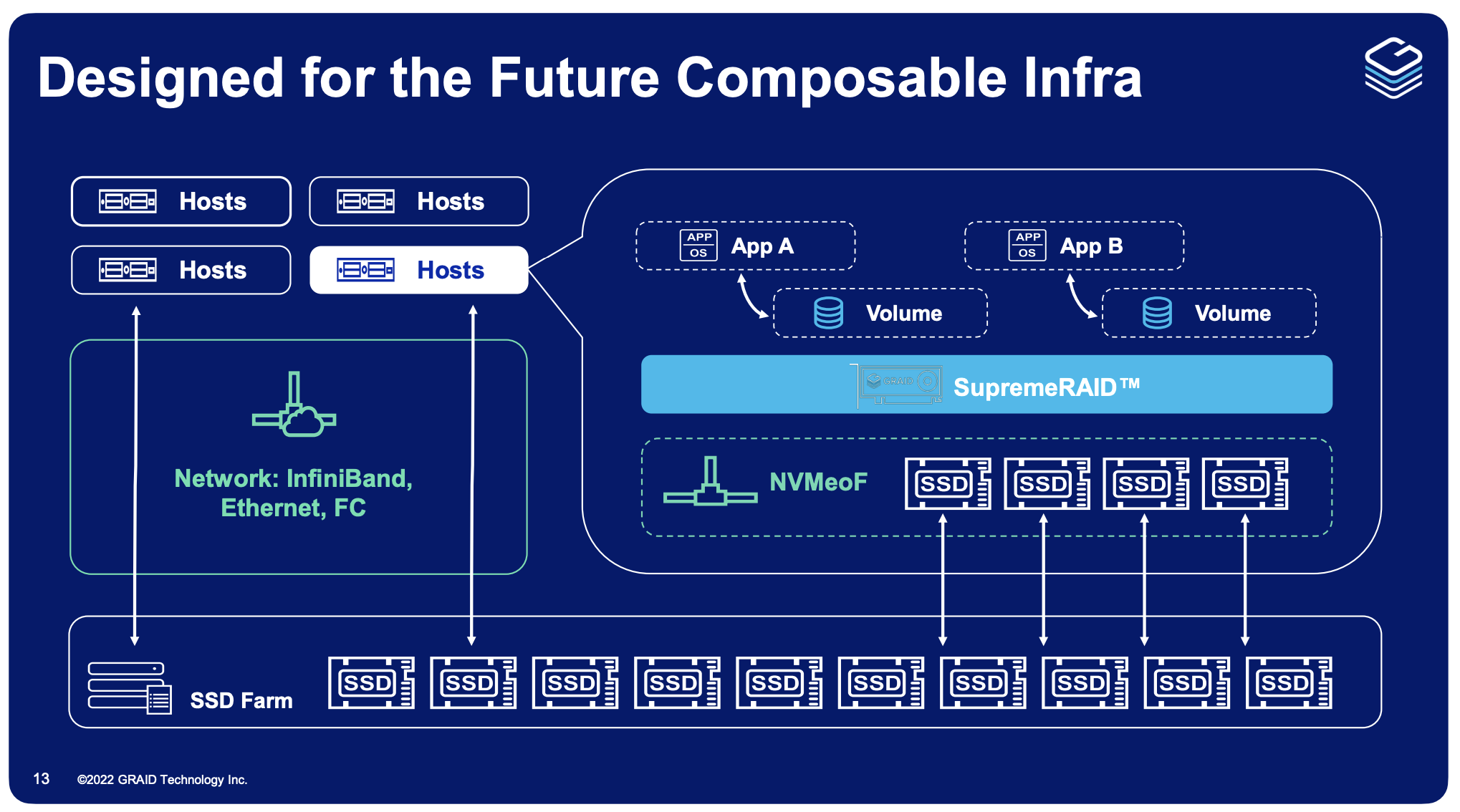

Parmi les concurrents de Graid, citons tout d'abord le géant Broadcom et sa carte MegaRaid reposant sur un ASIC et conçue à l'origine pour les disques durs. Elle assure 200 000 IOPS et supporte au maximum quatre SSD NVMe. Intel de son côté propose une solution logicielle VROC associée à ses cartes mères : elle plafonne à 21 900 IOPS, selon des tests réalisés par StorageReview. Graid met en avant des performances de 750 00 IOPS pour sa carte SR-1000 et 1,5 million pour la SR-1010 (en Raid 5). « Nous gérons les SSD locaux sur le serveur, mais nous pouvons également aller à travers le réseau et nous ne nous soucions pas de savoir si c'est InfiniBand, Ethernet ou du Fibre Channel, complète le dirigeant. Interrogé sur la compétition avec les cartes équipées de circuits FPGA ou les DPU, Tom Paquette estime que « les premiers sont très chers et très difficiles à programmer, et les seconds pas assez puissants pour notre usage. Nous ne développons que du logiciel et utilisons les GPU du marché comme ceux de NVidia ». Des discussions sont également en cours avec Intel et AMD pour exploiter leurs GPU. « Nous avons longuement parlé à Intel à propos de leur GPU, si jamais il arrive. Nous allons absolument porter notre logiciel sur le GPU d'Intel, afin de faire partie de leur écosystème. Nous pensons que c'est une étape importante pour nous en tant que société. Nous avons aussi parlé à AMD qui était vraiment intéressé par notre technologie et ce que nous pouvons faire avec un GPU. Et ils ont accepté de travailler sur GPU massif qu'ils veulent mettre dans un environnement HPC ».

Arrow et Tech Data comme partenaires

Tous les six à sept mois, Graid pousse une mise de jour de son logiciel, ajoutant des fonctionnalités demandées par les clients. « Notre solution est beaucoup plus flexible que celle reposant sur un ASIC ou un FPGA, parce que la rotation de ces circuits n'est pas une mince affaire. Et nous serons bientôt prêts pour le cloud natif, courant 2023. Un acteur français, OVH, est intéressé par la solution. Equinix aussi, mais ils font les choses un peu différemment, car ils servent une multitude de clients. Toujours dans la partie datacenter, Kubernetes et VMware seront supportés en 2023, et une interface graphique pour Windows est également bien avancée (pas avant 2024). « Ce n'est pas vraiment nécessaire pour Linux parce que les gens aiment notre ligne de commandes », nous a expliqué Tom Paquette.

Composable ready, Graid attend l'arrivée du protocole CXL pour exploiter toutes les ressources de l'interface PCI 5.0. (Crédit S.L.)

Pour vendre sa solution, Graid travaille avec des partenaires comme Arrows et des fournisseurs comme WD et Gigabyte, qui est aussi un des investisseurs de la start-up. « Nous faisons partie du programme de co-marketing de WD, et participons également à celui d'Intel : Network Builders. De son côté, Arrows nous accompagne aux USA, mais également en Europe ». Et, Tech Data vient juste de rejoindre Arrows. « Nous allons commencer avec eux dès maintenant en Amérique du Nord. Nous avons littéralement signé avec eux la semaine dernière. Et nous sommes en train de passer par l'onboarding. Maintenant, les numéros de pièces sont créés dans leur système. Donc quand quelqu'un veut acheter nos produits, il peut le faire». D'autres discussions sont plus difficiles, avec HPE par exemple alors que Lenovo se montre plus intéressé.